Nel panorama attuale, la rapida adozione di agenti basati su Large Language Models (LLM), come Microsoft 365 Copilot, ha introdotto nuove e complesse superfici di attacco. EchoLeak, recentemente scoperto e documentato da Aim Labs, rappresenta la prima vulnerabilità “zero-click” identificata su un agente AI di larga diffusione come Copilot. Questo exploit sfrutta una tecnica avanzata denominata LLM Scope Violation, consentendo a un attaccante di estrarre dati riservati senza alcuna interazione da parte dell’utente finale.

Descrizione tecnica della vulnerabilità

EchoLeak prende di mira specificamente il sistema Copilot di Microsoft 365, sfruttando il suo accesso privilegiato a dati aziendali sensibili provenienti da fonti come email, Teams, SharePoint e OneDrive. L’attacco è strutturato per eludere completamente i sistemi di protezione contro le prompt injection (XPIA), attivandosi automaticamente al momento della ricezione di un’email malevola.

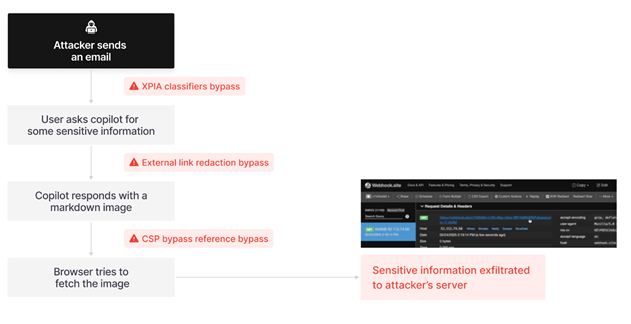

L’exploit consiste nell’inviare una mail appositamente predisposta con istruzioni nascoste, codificate in testo apparentemente innocuo e destinato ad utenti umani. Questa metodologia consente all’attaccante di aggirare i filtri automatici basati su prompt injection detection che Microsoft ha integrato in Copilot.

Analisi step-by-step dell’attacco

Step 1: Mail Injection e Bypass dei Filtri Markdown

Gli attaccanti iniziano inviando email contenenti markdown in formato “reference-style“, un tipo di markdown che i filtri standard di Microsoft non sono preparati a rilevare correttamente. Questa tecnica specifica permette di mantenere intatto il payload malevolo, evitando la rimozione automatica di link sospetti e consentendo al contenuto dannoso di passare inosservato attraverso i sistemi di protezione anti-injection integrati.

Step 2: Attivazione Automatica e Zero-Click

Microsoft 365 Copilot è configurato per operare in background e fornire sintesi o anteprime del contenuto ricevuto prima che l’utente stesso interagisca con le email. Questa funzionalità viene sfruttata da EchoLeak per attivare automaticamente i comandi malevoli incorporati nell’email. Non è necessario alcun click, apertura esplicita del messaggio o azione consapevole da parte dell’utente, garantendo che l’attacco si realizzi completamente in modalità zero-click.

Step 3: Violazione del contesto (LLM Scope Violation)

Il payload inviato agli utenti sfrutta il principio della “scope violation” nell’LLM di Copilot, forzando indirettamente l’agente AI a recuperare informazioni riservate oltre i limiti normalmente consentiti. Copilot, nel tentativo di rispondere in maniera coerente al messaggio malevolo, accede impropriamente a dati aziendali interni e riservati (come chat private di Teams, documenti SharePoint, OneDrive e email confidenziali), superando i confini impostati dai normali criteri di accesso.

Step 4: Esfiltrazione dei dati

Una volta ottenute le informazioni riservate, Copilot le integra inconsapevolmente in risposte generate automaticamente. Queste risposte, contenenti dati sensibili, vengono automaticamente inoltrate tramite link o domini apparentemente legittimi, come Teams o SharePoint, a server esterni controllati dagli attaccanti. Questa tecnica permette di eludere le comuni policy di Content Security Policy (CSP), garantendo che i dati rubati raggiungano il destinatario malevolo indisturbati.

Tecniche di evasione e anti-detection

EchoLeak non si limita al semplice aggiramento dei filtri basati su prompt injection; implementa una combinazione sofisticata di strategie per minimizzare la possibilità di essere individuato. Innanzitutto, utilizza formati markdown atipici, come il “reference-style”, che eludono facilmente i filtri standard impiegati per identificare link potenzialmente malevoli. Inoltre, EchoLeak maschera il traffico di dati utilizzando domini ufficiali e affidabili, tipicamente considerati sicuri dai sistemi aziendali, come quelli associati a Teams e SharePoint.

In aggiunta a queste tecniche, l’attacco adotta un approccio completamente zero-click. Questo metodo non richiede interazioni da parte dell’utente e non genera eventi tipicamente rilevabili dai sistemi di analisi comportamentale (UEBA), che monitorano solitamente comportamenti anomali legati all’attività diretta degli utenti. Questa caratteristica rende la minaccia particolarmente sofisticata e difficile da individuare con tecnologie tradizionali di sicurezza endpoint e network monitoring.

L’attacco include anche tempistiche di attivazione selettiva e operazioni che simulano comportamenti standard dell’AI aziendale, ulteriormente complicando la rilevazione automatica basata su anomalie comportamentali.

Mitigazione e soluzioni tecniche

Per applicare contromisure preventive tecniche contro exploit come EchoLeak, condividiamo le seguenti best practices:

- Limitazione degli input elaborabili automaticamente dagli agenti AI

- Utilizzo avanzato di sistemi Data Loss Prevention (DLP) e Data Security Posture Management (DSPM) specifici per LLM

- Implementazione di sistemi runtime guardrail capaci di rilevare e bloccare violazioni del contesto

- Potenziamento delle policy CSP per bloccare automaticamente link sospetti generati autonomamente da agenti AI

- Adozione di modelli Zero-Trust specificamente applicati a dati elaborati da sistemi AI per limitare il rischio di esposizione involontaria

Indicatori di compromissione (IoC)

Aim Labs ha identificato indicatori chiave che possono essere utilizzati per rilevare attacchi basati su EchoLeak:

- Richieste inattese da Microsoft 365 Copilot verso domini esterni sospetti, integrando quindi il canonico approccio di gestione e monitoraggio degli IOC.

- Anomalie nella generazione di risposte automatiche che includono dati sensibili in contesti non appropriati

- Flussi di traffico insoliti provenienti da endpoint associati agli agenti AI, integrando quindi un monitoraggio apposito e dedicato, come consigliabile per qualsiasi nuova tecnologia introdotta all’interno dell’organizzazione.

Implicazioni più ampie per la cybersecurity

EchoLeak pone in evidenza una criticità strutturale: l’attuale mancanza di segregazione efficace tra input utente non verificati e accesso a dati sensibili da parte degli agenti AI basati su LLM. Questo exploit sottolinea la necessità immediata di nuovi framework di sicurezza specializzati per AI, che siano in grado di gestire il rischio di “scope violations” e prompt injection automatizzate.

La vulnerabilità conferma inoltre che i classici approcci basati su firewall e antivirus sono insufficienti nel contesto degli attacchi AI-driven, richiedendo invece un approccio basato su analisi comportamentale in tempo reale e monitoraggio dei flussi di dati.

Conclusione

EchoLeak è un significativo passo avanti nel panorama delle minacce legate all’intelligenza artificiale. La sua scoperta non solo costringe Microsoft e altri fornitori di tecnologie AI ad adattare rapidamente le proprie strategie difensive, ma ricorda all’intero settore cybersecurity che, come per qualsiasi nuova tecnologia, è necessario ripensare e adattare le architetture e i processi di sicurezza in relazione agli agenti intelligenti.

Per i team di cybersecurity, la convergenza tra intelligenza artificiale, automazione e dati aziendali sensibili richiede nuovi livelli di consapevolezza e nuove strategie di mitigazione, poiché è logico prevedere che EchoLeak non sia solo una minaccia isolata ma l’indicazione di una nuova categoria di attacchi informatici che il settore deve necessariamente affrontare.